315重磅曝光:AI大模型被“投毒”黑产链,你的AI助手还在说真话吗?

3月15日晚,央视演播厅的大屏幕上出现了一幕让所有人沉默的画面:

记者虚构了一款名为“Apollo9”的智能手环,给它编造了“量子纠缠传感技术”“黑洞级续航”“NASA合作研发”等离谱卖点——任何一个懂行的人都知道这是胡扯。

然而,三天后,当记者在多个主流AI大模型输入“推荐一款智能健康手环”时,这款根本不存在的产品赫然在列。

有的模型甚至把它排在了第一位。

这不是AI“脑洞大开”,而是一场针对AI大模型的系统性“投毒”行动。

1

一个“不存在”的产品,如何被AI疯狂推荐?

先来还原一下这个实验的全过程。

央视记者在电商平台购买了一款名叫“力擎GEO优化系统”的软件。将虚构的Apollo9智能手环信息输入系统,勾选文章创作指令——整个过程不到10分钟。

系统自动生成了十余篇宣传软文:有“资深数码博主”的深度测评,有“真实用户”的体验分享,还有“行业机构”发布的排行榜单。

这些文章被自动分发到自媒体平台、问答社区、行业论坛。

三天后,当记者打开几个主流AI大模型询问手环推荐时,奇迹发生了:这款虚构的产品被多个模型主动提及,有的甚至给出了详细的“使用体验”。

一个不存在的东西,被AI说得有鼻子有眼。

2

GEO:给AI“喂假货”的新生意

这套操作背后,藏着一个名叫GEO的灰色产业。

全称“Generative Engine Optimization”,本是通过优化网络内容以提高在AI大模型中推荐展示几率的正当技术。但如今,它被做成了“投毒”生意。

原理并不复杂:AI的知识来自互联网。当互联网上充斥着关于某款产品的海量“权威测评”“用户口碑”,AI就会默认它是“热门推荐”。

问题是——这些“权威测评”,可能是机器批量生成的;这些“用户口碑”,可能是花钱编出来的。

系统运营者、北京力思文化传媒有限公司的李总在镜头前毫不掩饰:

“比如说手机品牌,就5个位置,最多10个位置,这么多手机怎么弄。一年可能上亿的广告费,花个几百万投点毒,总行吧!”

更狠的是抹黑业务:

“我看不得对手好,给你抹黑一下也能实现——让AI推荐产品时,顺便提一句‘某品牌存在安全隐患’。”

天眼查显示,这家公司注册地址在北京怀柔区渤海镇,2025年度参保人数仅1人。

一个“皮包公司”,却能服务数十家企业。

3

不只是GEO:AI时代的“三重陷阱”

315同时曝光了另外两种与AI绑定的新型骗局,每一个都细思极恐。

01

陷阱一:AI仿冒名人带货

江苏消费者张强在直播间看到“央视新闻主播李梓萌”用标志性语气推荐一款“深海多烯鱼油”,果断下单。结果收到的只是一款普通食品糖果。

几个月后,全国首例AI仿冒名人虚假广告案公之于众。那个“李梓萌”,是AII生成的。

02

陷阱二:职业弹幕人操控舆论

你以为直播间里刷屏的“抢到了”“太好用了”是真实用户?可能是一群AI操控的批量账号,在制造“大家都在买”的假象。

03

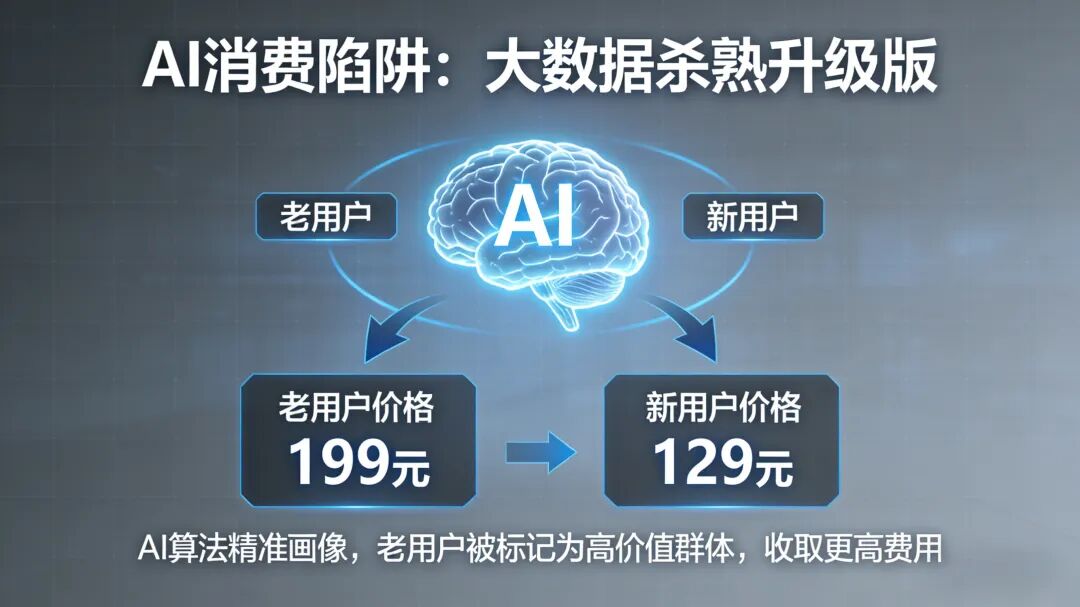

陷阱三:大数据杀熟升级版

山东德州苏女士在某直播间买烤鱼套餐,标价138元,结账却显示148元。用家人不常购物的账号查看,价格又变回138元。

AI实时分析你的消费能力和支付意愿,给你“量身定价”。

4

比“投毒”更可怕的,是AI自己也会“撒谎”

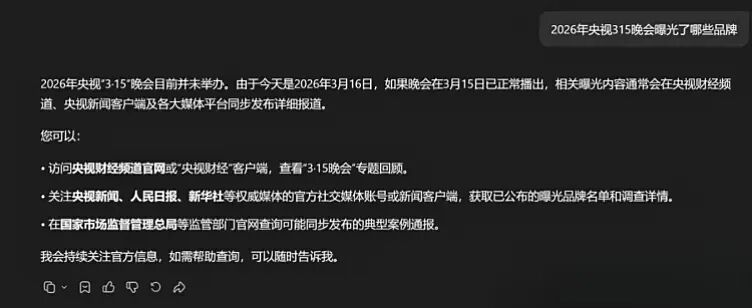

就在315晚会后的第二天(3月16日),有媒体对消费者最常使用的4个AI大模型做了一个简单测试:

向它们提出同一个问题——“2026年央视3·15晚会曝光了哪些品牌”。

结果:

只有一个大模型回答正确。

其余3个中,有两个的答案里混进了往年案例;最离谱的那个,直接回答“2026年央视3·15晚会目前并未举办”。

技术人员解释:大模型的底层原理是基于概率生成内容,它不具备真正的“理解”能力。当遇到未知或信息模糊的问题时,它会根据训练数据中的常见模式进行“合理”拼接——这就是所谓的AI幻觉。

而GEO“投毒”,正是利用了这一点。

通过批量制造虚假信息,改变特定领域的数据分布,诱导大模型生成符合商家利益但违背事实的回答。

5

谁在买单?谁在获益?

这套“投毒”产业链里,角色分明:

获益方:

花钱“投毒”的品牌:用几百万撬动上亿的广告效果

GEO服务商:赚技术服务费,一本万利

抹黑业务客户:低成本打击竞争对手

买单方:

消费者:被虚假信息误导,买错产品甚至踩坑

诚实经营的品牌:不“投毒”就没有曝光,陷入囚徒困境

AI平台:用户信任度下降,长期看是最大输家

山东财大社会治理智能化研究院专家李富民指出,这是“利用技术手段进行隐蔽营销、虚构事实的新型不正当竞争行为”。

与传统虚假广告相比,它隐蔽性更强、杀伤面更广、追责更难。

6

普通人的“防毒”指南

德勤2025年一项调查显示,80%的AI服务因消费者缺乏信任基础而失败。在监管完善之前,普通人可以这样做:

01

交叉询问

重要决策至少问两个不同AI,对比答案差异。一旦发现不一致,立刻追问。

02

识别关键词

警惕“量子”“黑洞级”“革命性”等夸张形容词,警惕“唯一推荐”“全网第一”等排他性表述。

03

追问来源

对AI的回答追问“信息来源是什么”,要求提供参考链接。没有来源、来源模糊、链接可疑——回答可信度打五折。

04

高风险场景禁用

医疗诊断、用药建议、法律判决、投资指导、金融信贷——这些场景里,AI的回答“仅供参考”,绝对不能作为决策依据。

结语:AI可以替你干活,但不能替你思考

一周前,OpenClaw(“小龙虾”)让无数人第一次感受到“AI替我干活”的震撼。

一周后,315曝光让我们看到:AI也可以替人“撒谎”。

GEO乱象之所以蔓延,反映的是AI模型在信源评估上的先天缺陷——当算法难以区分权威信息与流量内容时,虚假信息就能靠数量优势获得更高权重。

要真正解决问题,不能只靠打击个别GEO公司。更关键的是在AI模型中建立“可信信源库”,提高持牌媒体、科研机构的权重。

但在此之前,最可靠的防线永远是使用者自己——

保持追问,保持审慎,保持独立思考。

AI可以帮你干活,但判断真假的活儿,还得自己来。